|

2015年12月23日 17:18:52

公司前些日子准备在项目中使用 光学字符识别技术,

(也就是我们经常听说的,你拿着相机,照一下,之后就能直接显示图片中的文字是什么)

之后我在 GIT 上找了一个歪果友仁的 Demo, 对他的项目进行简单地解析,以此来帮助其他小伙伴,简单的了解一下.

Demo: https://github.com/hatena-iti/tesseract-sample

注意: 下面开启唐僧模式,对 OCR 已经有一定了解或只是想使用的同学可以直接跳到代码部分..

首先来介绍一下 OCR 到底是什么.

OCR是指电子设备(例如扫描仪或数码相机)检查纸上打印的字符,

通过检测暗、亮的模式确定其形状,然后用字符识别方法将形状翻译成计算机文字的过程.

其中 通过检测暗、亮的模式确定其形状 在我们的开发中,就涉及到图片的二值化等一系列操作,设计

OPEN_CV或 OPEN_GL等.

ps:图像的二值化,就是将图像上的像素点的灰度值设置为0或255,也就是将整个图像呈现出明显的只有黑和白的视觉效果.

例如这样:

而经过二值化处理的图片,

是不是觉得很像复印的照片呢.233...

了解了图片的基本原理,接下来就到了介绍工具的部分.

我们程序中最重要的第三方库 TesseractOCR.framework

工具下载地址:

TesseractOCR.framework: https://github.com/gali8/Tesseract-OCR-iOS

<span style="font-size:18px;">@interface Tesseract : NSObject

@property (nonatomic, strong) NSString* language;

@property (nonatomic, strong) UIImage *image; @property (nonatomic, assign) CGRect rect;

@property (nonatomic, readonly) short progress; // from 0 to 100 @property (nonatomic, readonly) NSString *recognizedText;

@property (nonatomic, weak) id<TesseractDelegate> delegate;</span>

它的代理方法如下

<span style="font-size:18px;">- (id)initWithDataPath:(NSString *)dataPath language:(NSString *)language DEPRECATED_ATTRIBUTE; - (id)initWithLanguage:(NSString*)language; - (void)setVariableValue:(NSString *)value forKey:(NSString *)key;

- (void)clear DEPRECATED_ATTRIBUTE;</span>

我们在使用当中需要传递给 TesseractOCR 我们需要解析的语言,我们需要解析的图片,并告诉程序,我们是否承认.

需要注意的是,TesseractOCR默认支持英文和数字,毕竟人家才26个字母外加0-9这几个数字,

如果需要识别额外的语言,则需要在 tessdata 文件下 添加对应的语言包.

磨叽了一大堆,下面开始代码部分..

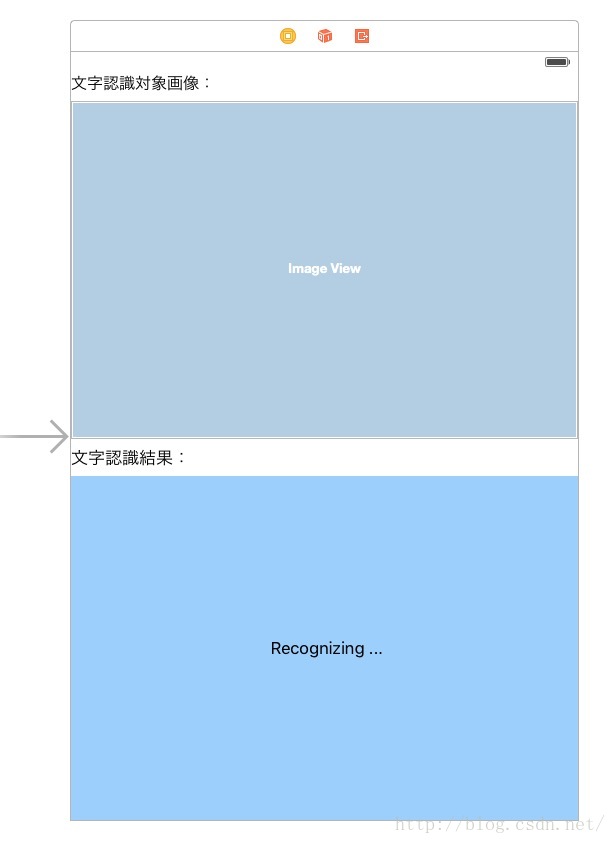

首先在 StroyBoard 中 创建我们需要的图像展示区和文字展示区.

之后将其拉入 ViewController.h 中 作为属性.

<span style="font-size:18px;">#import <UIKit/UIKit.h> #import <TesseractOCR/TesseractOCR.h>

@interface ViewController : UIViewController<TesseractDelegate>

@property (nonatomic, strong) IBOutlet UIImageView *imageView; @property (nonatomic, strong) IBOutlet UILabel *label;

之后在.m 文件中,也同样创建属性方便我们之后的使用.

<span style="font-size:18px;">// kImageFileName の値を @"ocr-sample-japanese"(日本語文字サンプル)に指定した場合は、 // kLanguage の値を @"jpn" に指定します。 // kImageFileName == @"ocr-sample-english" の場合は、kLanguage = @"eng" とします。)

//static NSString * const kImageFileName = @"ocr-sample-japanese"; // 日本語文字サンプル //static NSString * const kImageFileName = @"ocr-sample-english"; // 英数字サンプル static NSString * const kImageFileName = @"ocr-sample-chinese"; // 汉文サンプル

//static NSString * const kLanguage = @"jpn"; <span style="white-space:pre"> </span> // 解析対象言語:日本語 //static NSString * const kLanguage = @"eng"; <span style="white-space:pre"> </span> // 解析対象言語:英語 static NSString * const kLanguage = @"chi_sim"; <span style="white-space:pre"> </span> // 解析対象言語:中文</span>

同时再去声明一个属性

<span style="font-size:18px;">@implementation ViewController { // 文字解析用に加工したイメージデータを保持するフィールド

之后

<span style="font-size:18px;">//@synthesize是在m文件中定义setter和getter方法的实现 @synthesize imageView=imageView_; @synthesize label=label_;</span>

至此前期准备工作已经结束.

接下来到程序的运行阶段.

<span style="font-size:18px;">- (void)viewDidLoad {

self.imageView.image = [UIImage imageNamed:kImageFileName];

[UIApplication sharedApplication].networkActivityIndicatorVisible = YES;

记得

<span style="font-size:18px;">- (void)dealloc { [UIApplication sharedApplication].networkActivityIndicatorVisible = NO;

之后重头戏来了,首先我们需要对我们的图片进行简单的处理,加强黑白色的对比,以此增强我们文字的轮廓的清晰度,

文字的清晰度对文字的检测的成功率有很大的影响.

对图片进行了简单的处理之后,我们就将我们处理之后的图片传入我们的第三方库.并将识别出的文字返回,展示给我们.

代理方法可以展示我们对当前图片的解析程度达到了多少.

<span style="font-size:18px;">// 文字解析を実行する dispatch_async(dispatch_get_global_queue(DISPATCH_QUEUE_PRIORITY_BACKGROUND, 0), ^{

CIImage *ciImage = [[CIImage alloc] initWithImage:self.imageView.image];

//文字を読みやすくするため、白黒にして、コントラストを強めに、また輪郭をくっきりさせるよう設定する [CIFilter filterWithName:@"CIColorMonochrome" keysAndValues:kCIInputImageKey, ciImage, @"inputColor", [CIColor colorWithRed:0.75 green:0.75 blue:0.75], @"inputIntensity", [NSNumber numberWithFloat:1.0], [CIFilter filterWithName:@"CIColorControls" keysAndValues:kCIInputImageKey, [ciFilter outputImage], @"inputSaturation", [NSNumber numberWithFloat:0.0], @"inputBrightness", [NSNumber numberWithFloat:-1.0], @"inputContrast", [NSNumber numberWithFloat:4.0],

[CIFilter filterWithName:@"CIUnsharpMask" keysAndValues:kCIInputImageKey, [ciFilter outputImage], @"inputRadius", [NSNumber numberWithFloat:2.5], @"inputIntensity", [NSNumber numberWithFloat:0.5],

CIContext *ciContext = [CIContext contextWithOptions:nil]; [ciContext createCGImage:[ciFilter outputImage] fromRect:[[ciFilter outputImage] extent]];

// 文字解析対象の画像の色、コントラストを調整したものを変数に保存する UIImage *adjustedImage = [UIImage imageWithCGImage:cgImage]; //---------------------------------------------------------------------------------------------- Tesseract* tesseract = [[Tesseract alloc] initWithLanguage:kLanguage]; tesseract.delegate = self; [tesseract setImage:adjustedImage]; //image to check NSString *recognizedText = [tesseract recognizedText]; tesseract = nil; //deallocate and free all memory

dispatch_async(dispatch_get_main_queue(), ^{ self.label.text = recognizedText; NSLog(@"\n\n%@",recognizedText); [UIApplication sharedApplication].networkActivityIndicatorVisible = NO;

代理方法(可用作展示解析程度).

<span style="font-size:18px;">#pragma mark - TesseractDelegate methods

- (BOOL)shouldCancelImageRecognitionForTesseract:(Tesseract*)tesseract { NSLog(@"progress: %d", tesseract.progress); return NO; // return YES, if you need to interrupt tesseract before it finishes

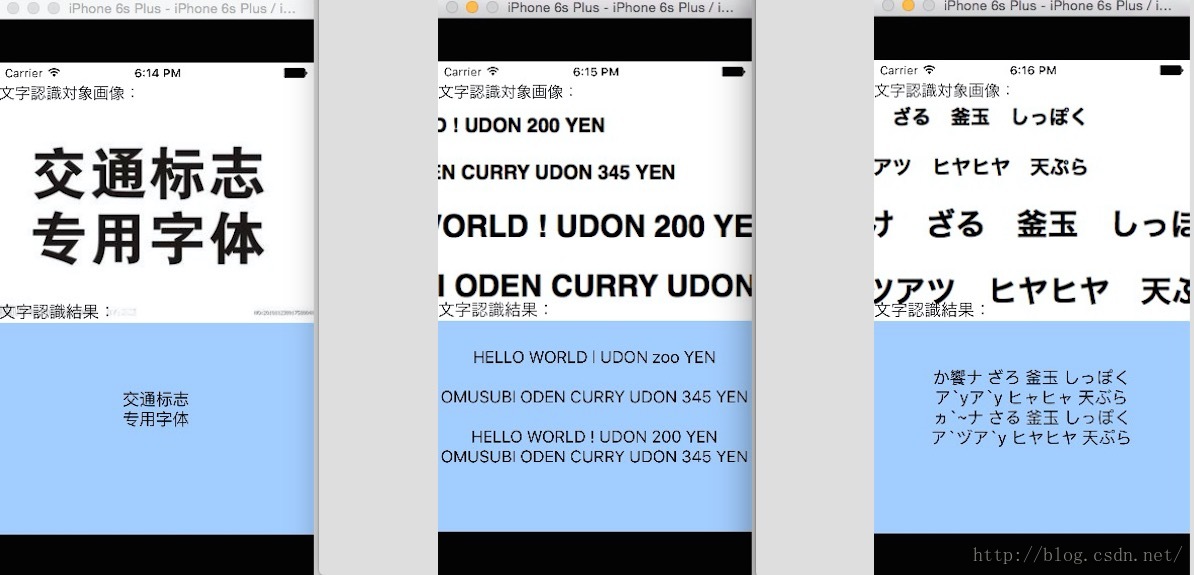

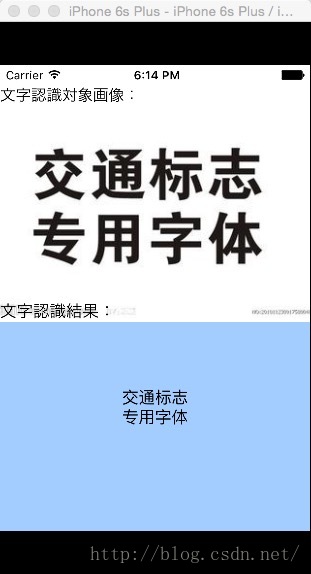

最后效果:

完结撒花!~

更多精彩文章,尽在我的公众号.

|